2024년 5월 20일

생성형 AI (Generative AI)

1. 생성형 AI (Generative AI)의 개요

(1) 생성형 AI의 개념 및 특징

| 개념 | 특징 |

|---|---|

| 대규모 데이터에서 패턴과 규칙을 학습하여 사용자 요구에 따라 언어, 이미지, 영상 등의 결과물을 능동적으로 생성하는 AI 기술 | – 대규모 데이터 학습 및 자율 판단 수행 – 사용자 요구에 따라 새로운 콘텐츠 생성 – 언어 대화 등 사람과 자연스러운 상호작용 |

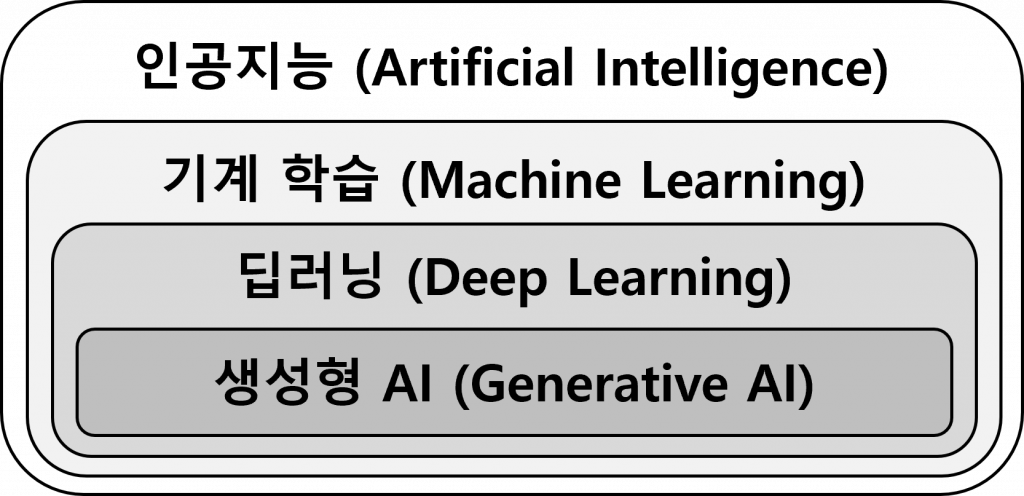

(2) 인공지능과 생성형 AI의 관계

| |

|---|---|

| 인공지능 (Artificial Intelligence) | 인간의 지능을 모방하여 인간처럼 사고/행동하는 가장 큰 범위를 포괄하는 개념 |

| 기계 학습 (Machine Learning) | 컴퓨터가 데이터를 통해 학습할 수 있도록 하는 알고리즘과 기술 (머신러닝) |

| 딥러닝 (Deep Learning) | 인공 신경망을 깊고 넓게 복합적으로 쌓아 학습을 수행하는 방식 |

| 생성형 AI (Generative AI) | 데이터를 학습하여 사용자 요구에 따라 결과물을 능동적으로 생성 |

- 기존 딥러닝 기반 AI 기술이 단순히 기존 데이터를 기반으로 예측하거나 분류하는 정도였다면, 생성형 AI는 사용자가 요구한 질문이나 과제를 해결하기 위해 스스로 데이터를 찾아서 학습하여 이를 토대로 능동적으로 데이터나 콘텐츠 등 결과물을 제시하는 한 단계 더 진화한 AI 기술

2. 생성형 AI 구현 계층 및 핵심 요소

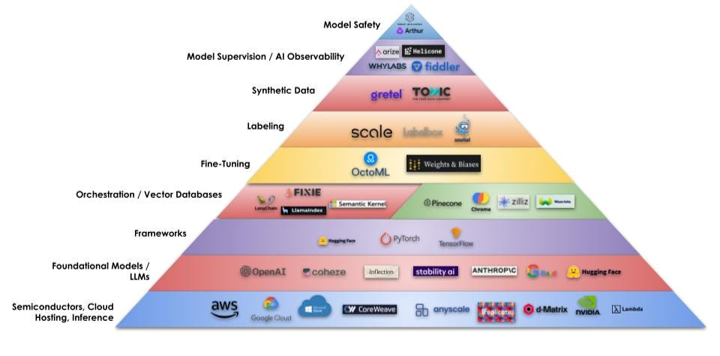

(1) 생성형 AI 구현 계층

|

(2) 생성형 AI 구현 계층 별 핵심 요소

| 계층 | 핵심 요소 | 역할 / 솔루션 |

|---|---|---|

| AI 모델 관리 | 모델 안전성 | – 편향된 결과물 생성 제어, 모델 안전성 확보 – Arthur AI, Credo AI, Skyflow |

| 모델 감독 / AI 가시성 | – AI 모델 동작 모니터링 및 감독, 설명 가능한 AI – Arize, WhyLabs, Aporia, Helicone, fiddler | |

| 학습 데이터 효율화 | 합성 데이터 | – 실제 데이터 모방, 부족한 학습 데이터 확보 – Gretel.ai, Tonic.ai |

| 라벨링 | – 데이터의 설명 역할, AI 모델에 필요 정보 훈련 – Labelbox, Scale, Snorkel AI | |

| AI 모델 최적화 | 파인 튜닝 | – AI 모델 세부 조정, 특정 작업/데이터 추가 학습 – Weights and Bias, OctoML |

| 오케스트레이션 | – AI 모델을 다양한 데이터 소스와 통합 – LangChain, LlamaIndex, FIXIE, Semantic Kernel | |

| 벡터 데이터베이스 | – AI 모델이 생성한 벡터 저장 및 검색 – Pinecone, Chroma, Weaviate, Zilliz | |

| 기반 환경 제공 | 프레임워크 | – AI 모델 구축을 위한 개발 프레임워크 – Hugging Face, PyTorch, TensorFlow |

| 파운데이션 모델 / LLM | – LLM 등 다양한 작업에 적용 가능한 범용 AI 모델 – OpenAI, cohere, Stability AI, Anthropic, Hugging Face | |

| 클라우드 / IT 인프라 | – Cloud, GPU 가상화 등 AI 서비스 컴퓨팅 인프라 제공 – AWS, Azure, GCP, NVIDIA, CoreWeave |

- 생성형 AI 서비스는 IT 인프라부터 AI 모델 관리까지 여러 계층별 솔루션을 기반으로 구성되며, 언어, 이미지, 영상 등을 인식하고 학습하여 사용자의 요구에 따라 능동적으로 결과물을 생성하는 서비스로 활용

3. 생성형 AI의 분야 별 활용 사례/기술 요소

| 분야 | 활용 사례 | 기술 요소 | 세부 요소 |

|---|---|---|---|

| 언어 생성 | – ChatGPT / OpenAI – PaLM / Bard – OCEAN / 하이퍼클로바X – DALL-E / OpenAI | 트랜스포머 | – Self-Attention – Positional Encoding |

| 전이 학습 | – Domain Adaption – Fine-Tuning | ||

| 영상 생성 | – Gen-1, Gen-2 / Runway – Phenaki, Dreamix / Google | GAN | – Generator – Discriminator |

| VAE | – Encoder/Decoder – Reparameterization Trick | ||

| 영상 인식 | – Make-A-Video / Meta – Imagen Video / Google | SAM | – Image Encoder/Mask Decoder – Prompt/Output Token |

| HQ-SAM | – Prompt/Output/HQ-Output Token – Global-local Fusion | ||

| 모션 생성 | – NPC / Metaverse – Code Assist / Roblox | MotionGPT | – Text-to-Motion – Motion-to-Motion |

- ChatGPT와 같은 대규모 언어 모델(LLM) 등 생성형 AI 기술의 보안 위협으로 잘못된 정보, AI 모델 악용, 유사 AI 모델 서비스 빙자, 데이터 유출, 플러그인 취약점, 확장 프로그램 취약점, API 취약점 등이 존재

4. 생성형 AI의 보안 위협과 대응 방안

(1) 생성형 AI의 보안 위협

| 보안 위협 | 위협 원인 | 가능한 보안 위협 |

|---|---|---|

| 잘못된 정보 | – 편향 (Bias) – 최신 데이터 학습 부족 – 환각 현상 | – 사회적 혼란 조장 – 고위험 의사 결정 – 잘못된 의사 결정 유도 |

| AI 모델 악용 | – 적대적 시스템 메시지 | – 피싱 이메일 및 인물 도용 – 사이버 보안 위협 코드 작성 – 대화형 서비스를 악용한 사이버 범죄 커뮤니티 활성화 – 사회 공학적 영향 – 가짜 뉴스 생성 |

| 유사 AI 모델 서비스 빙자 | – 유사 악성 서비스 접근 유도 | – 스쿼팅 URL 및 확장 프로그램 – 가짜 애플리케이션 |

| 데이터 유출 | – 데이터 합성 과정의 문제 – 과도한 훈련 데이터 암기 문제 – 대화 과정에서 개인정보 및 민감 정보 작성 | – 훈련 데이터 유출 – 데이터 불법 처리 우려 – 기밀 유출 – 대화 기록 유출 – 데이터베이스 해킹, 회원 추론 공격 |

| 플러그인 취약점 | – AI 모델의 적용 범위 확장 – 안정성 확인 미흡 – 해커 공격 범위 확장 – 취약점이 있는 서비스와 연결 | – 새로운 도메인에서의 모델 오작동 – AI 에이전트 모델의 악용 – 멀티모달 악용 |

| 확장 프로그램 취약점 | – 확장 프로그램 내부 악성 서비스 – 서비스 제공 업체 보안 조치 미흡 | – 개인정보 수집 – 시스템 공격 – 호스팅 서버/스토리지 시스템 위협 |

| API 취약점 | – 미흡한 API 키 관리 – 데이터/명령 사이 불분명한 경계 | – API 키 탈취 – 악의적인 프롬프트 주입 |

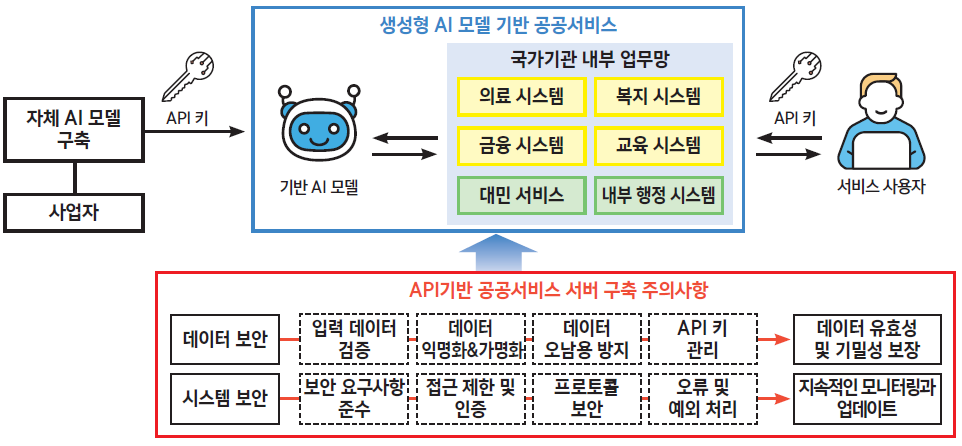

(2) 생성형 AI의 보안 위협 대응방안

|

- 생성형 인공지능(Generative AI) 보안 위협에 대비하여 ChatGPT 등 생성형 AI 기반 안전한 서비스를 구축/활용하기 위해 AI 모델 도입/활용 시 보안성을 고려해야 하며, 안전한 생성형 AI 서비스 구축을 위해 AI 모델 구축 단계별 보안 위협에 대응 필요

[참고]

- JONATHAN SHRIFTMAN, The Building Blocks of Generative AI

- 국가정보원(NIS), 챗GPT 등 생성형 AI 활용 보안 가이드라인, 2023.6