2019년 1월 14일

LSTM (Long Short Term Memory)

I. RNN 장기 의존성 문제 개선, LSTM

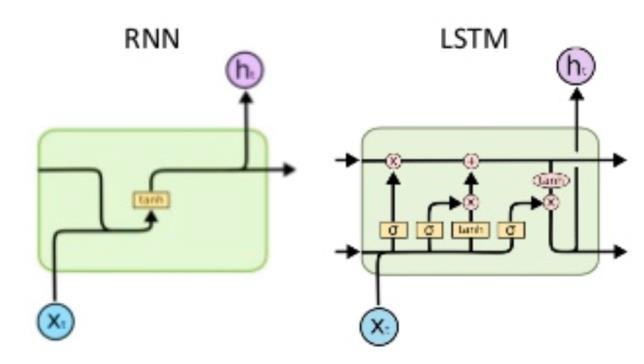

가. LSTM의 개념

| 개념도 |  |

| 개념 | 순환신경망의 장기 의존성 문제 해결하기 위해 셀 스테이트 기반 신경망 모델 |

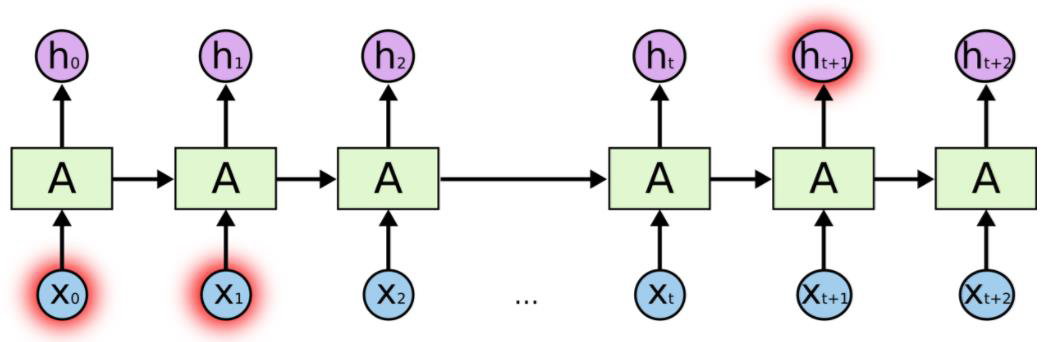

나. 순환신경망의 장기 의존성 문제

|

- RNN은 매번 Step마다 위 과정을 반복, 역전파 시 더 많은 곱셈 연산에 따른 경사 감소로 뒤 노드까지 영향 불가

- Step t에서의 hidden layer : ht(ht-1Whh)Whh

II. LSTM의 구조 및 Layer 별 역할

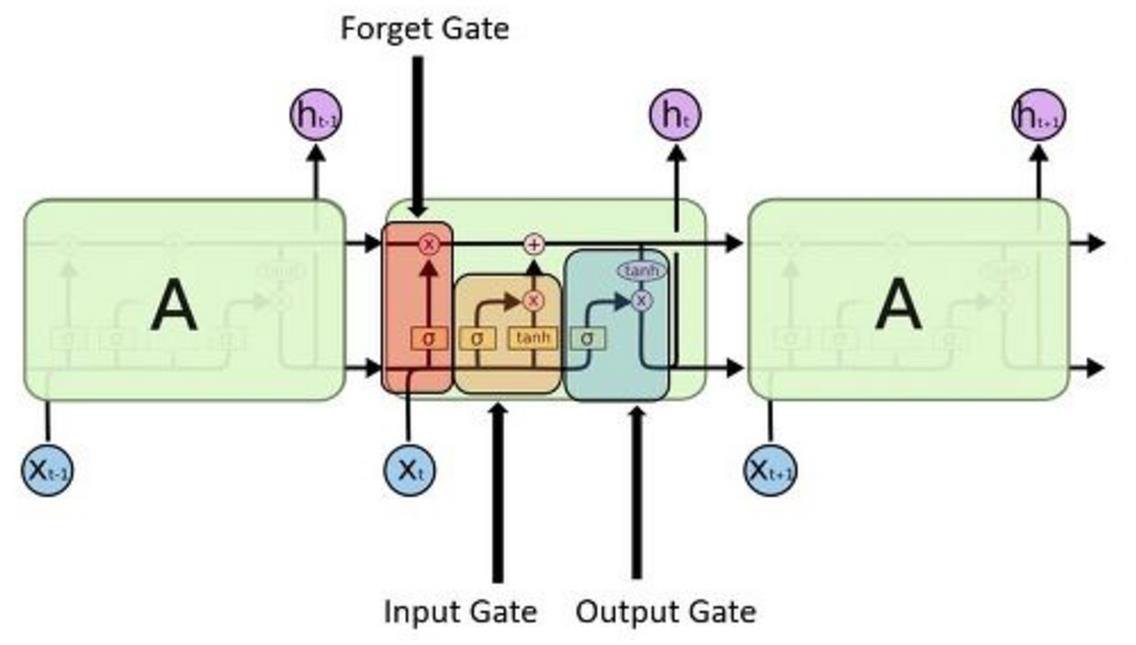

가. LSTM의 구조

|

- LSTM 핵심 아이디어: 셀 스테이트 (Cell State)

- LSTM에 들어있는 4개 상호작용 레이어가 있는 반복 모듈

나. LSTM의 Layer 별 역할

| 구분 | 구성요소 |

|---|---|

| Cell State | – Input, Forget, Output 게이트의 정보 반영 |

| Forget Gate | – 반영 Data를 결정하는 게이트 |

| Input Gate | – 새로운 정보가 Cell State에 저장 여부 |

| Update Gate | – Forget, Input Gate 출력 시 Cell State 갱신 |

| Output Gate | – 출력 값 결정 단계 |

III. LSTM의 동작 절차

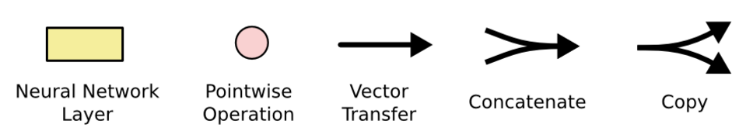

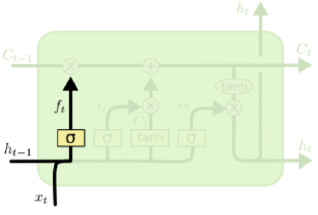

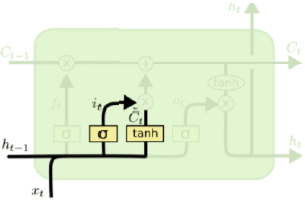

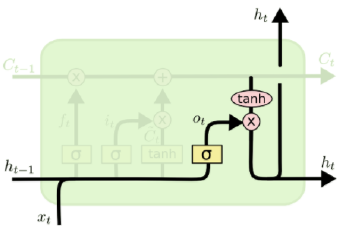

| 절차 | 개념도 | 설명 |

|---|---|---|

| Drop정보 선택 과정 |  | – Forget Gate Layer – 시그모이드 레이어로 만들어짐 |

| 저장 정보 선택 과정 |  | – Input Gate Layer – 업데이트 Data 결정 – Cell State에 저장 |

| 출력 정보 선택 과정 |  | – Output Gate Layer – 출력 Data 결정 – 다음 노드로 전파 |